İstihbarat ve savunma çalışmalarında yapay zekanın hızlı entegrasyonu, uzmanlar arasında ciddi kaygılar uyandırıyor. Nükleer caydırıcılık alanında çalışan bilim insanları, yapay zekanın askeri karar süreçlerine dahil edilmesinin krizleri yatıştırmak bir yana tırmandırabileceği endişesini vurguluyor.

Stanford Üniversitesi’nden Jacquelyn Schneider, savaş simülasyonlarında test edilen yapay zeka sistemlerinin çoğunlukla gerilimi azaltmaktan çok artırma yönünde etkiler sergilediğini belirtiyor. “Yapay zeka sanki gerilimi artırmayı anlıyor ama azaltmayı anlamıyor. Nedenini biz de bilmiyoruz” ifadesiyle bu tehlikeyi özetliyor.

Asıl risk, bu teknolojinin nasıl çalıştığı tam olarak anlaşılamamışken Pentagon karar süreçlerinde giderek daha fazla yer bulması. Uzmanlar iki olası senaryodan endişe ediyor: ya yapay zekaya doğrudan nükleer silah kullanma yetkisi verilecek ya da komutanlar onun tavsiyelerine körü körüne güvenerek hatalı ve ölümcül bir karara imza atacak.

Pentagon ise “nükleer silahlarda her zaman insan denetiminin süreceğini” iddia ediyor. Ancak uzmanlar, Rusya ve Çin gibi ülkelerin benzer teknolojilere yönelmesiyle bu ilkenin aşınabileceğini vurguluyor.

1

OpenAI, İşe Alımda Devrim: Yapay Zeka Destekli İş Platformu 2026’da Geliyor

10 kez okundu

1

OpenAI, İşe Alımda Devrim: Yapay Zeka Destekli İş Platformu 2026’da Geliyor

10 kez okundu

2

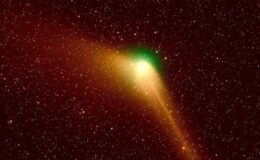

3I/ATLAS: Kuyruklu Yıldız mı, Kuyruklu Gölge mi? Güneşe Doğru Gelen Gizemin Net Görüntüleri

10 kez okundu

2

3I/ATLAS: Kuyruklu Yıldız mı, Kuyruklu Gölge mi? Güneşe Doğru Gelen Gizemin Net Görüntüleri

10 kez okundu

3

Çalışan Sistemler İçin Yaşanan Erişilebilirlik Krizi: ChatGPT Kesintileri ve Kullanıcı Tepkileri

9 kez okundu

3

Çalışan Sistemler İçin Yaşanan Erişilebilirlik Krizi: ChatGPT Kesintileri ve Kullanıcı Tepkileri

9 kez okundu

4

WhatsApp ve iOS 26 için Liquid Glass Tasarımı: İlk Adımlar ve Beklentiler

9 kez okundu

4

WhatsApp ve iOS 26 için Liquid Glass Tasarımı: İlk Adımlar ve Beklentiler

9 kez okundu

5

Tamagotchi: Nostaljinin Yeniden Doğuşu ve Küresel Popülarite

9 kez okundu

5

Tamagotchi: Nostaljinin Yeniden Doğuşu ve Küresel Popülarite

9 kez okundu